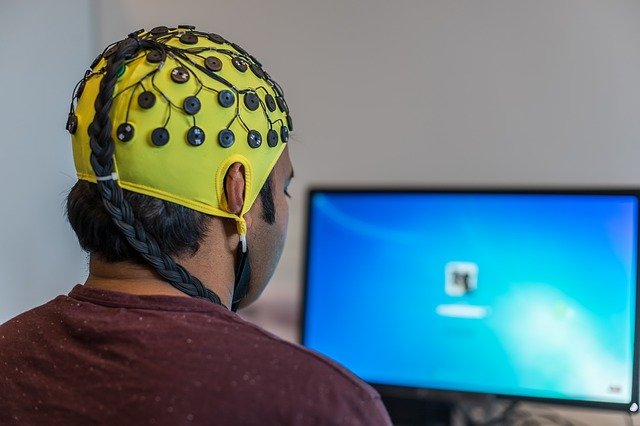

<PC実習付き>大規模言語モデルツールを用いた LLM の基礎的理解【提携セミナー】

| 開催日時 | 未定 |

|---|---|

| 担当講師 | 浅川 伸一 氏 |

| 開催場所 | 未定 |

| 定員 | - |

| 受講費 | 未定 |

★Transformers, LlamaIndex等、

数多くある大規模言語モデルのツールを解説し、実習を通してその実装を学んでいただきます

<PC実習付き>

大規模言語モデルツールを用いた LLM の基礎的理解

【提携セミナー】

主催:株式会社情報機構

◆はじめに

大規模言語モデル(LLM) は,多くの種類の実務処理課題に有用であり,注目されるようになっています。ですが,新規ユーザーは,LLM のツールやユーティリティの多さに戸惑うことになります。今回は,広く使われているこのようなツールのうち,いつくかを取り上げます。紹介するツールはすべて無償で提供されており,利用可能な多種多様な言語モデルを活用できます。具体的には,Transformers, LlamaIndex, Langchain, Ollama, Llamafile を取り上げる予定です。

◆受講後、習得できること

LLM の基礎的理解,一般的な LLM ツールの使い方,

埋め込み表現の理解,検索拡張生成,PPO,微調整,転移学習,自己注意,

◆受講対象者

・ 大規模言語モデル (LLM) の応用に関心のある方,

・ 複数の LLM 実装について,実際の使い方に迷っている方

・ 大規模言語モデルに興味,関心のある方

・ 本テーマに興味のある方なら、どなたでも受講可能です。

◆必要な予備知識

Google Colabratory, GitHub, Python の使用経験の使用経験があれば,理解が容易になるでしょう。必要な数学的知識はその都度補います

◆講演中のキーワード

Transformer, RAG(検索拡張生成), 転移学習(transfer learning), 微調整 (fine tuning), 代理方針最適化(proximal policy optimization), 自己注意(self-attention)

担当講師

東京女子大学 情報処理センター 助手 浅川伸一 氏

■専門および得意な分野・研究:

言語情報処理,人間の言語情報処理モデル,人工知能,神経回路網

■本テーマ関連学協会での活動:

日本人工知能学会,全脳アーキテクチャイニシアティブ,情報処理学会,日本ディープラーニング協会 (JDLA) 有識者会員

セミナープログラム(予定)

◎本セミナーでは「Google Colaboratory」を用いた演習を行います。

- 使用するプログラムは事前に送付予定ですが、当日配布の可能性もございます。

- 実習にあたりPCをご持参ください。事前にgoogle chromeのインストールをお願い致します。

- 最低限のgoogle colaboratryの操作は説明いたしますが、予め操作に慣れていれば

理解が促進されるかと思います。

◎Googleのアカウントとブラウザがあれば、本講演のPythonプログラムは実行可能です.

https://colab.research.google.com/

1)上記リンクにアクセスできる

2)ページ上部の「+ コード」に例えば「1+1」と入力、実行し答えが出力される

上記2点を満たせば、問題なく利用できるかと存じます。

※よくあるケースとして、セキュリティ設定のご関係で上記にアクセスできない事がございます。

必ず事前にご確認の上、もし可能でしたらアクセスできる設定にご変更お願い致します。

1. Transformers: 現代の自然言語処理(NLP)モデルフレームワークの最も著名なライブラリの 1 つである transformers は ,NLP 大手の Hugging Face 社から提供されている。Transformers で利用可能な訓練済みモデルの種類は膨大で,テキスト分類,翻訳,質問応答などのタスク用に設計された,基礎的なモデルと微調整されたモデルの両方がある。汎用性 (PyTorch や TensorFlow のようなバックエンド用のモデルが存在する) カスタマイズ可能な豊富な事前学習済みモデル,ユーザフレンドリーな API とドキュメント質問とヘルプに答えるための強固なユーザベース Transformers は,基本を習得するのが非常に簡単であるため,新規ユーザーに適している。しかも,複雑な課題でさえ十分有用であると考えられる。このライブラリには,ドキュメント,ユーザフレンドリーな API,利用可能なモデルが数多く収集されている。Transformers を使えば,初心者は深層学習の知識がなくても最先端のモデルを使い始めることができる。ところが,Transformers モデルの実装は複数存在し,実際にどれを使えば良いのか,迷うことになる。そこで本講演では,複数の LLM の実装を紹介し,実例を用いて各実装の相違を検討する。取り上げるモデルは,LlamaIndex, Langchain, Ollama, Llamafile を予定している。

2. LlamaIndex: LLM を利用する際に,検索拡張生成 (RAG) 用にカスタマイズされたデータフレームワーク。LLM と異なるデータ・ソース間の接続を効率化し,複雑なデータ・ベースの LLM アプリケーションを簡単に構築できる。

3. Langchain: AI エンジニアが言語モデルを膨大なデータソースや他の LLM と接続することを可能にするフレームワーク。Langchain には,コンテキストを認識する推論アプリケーションのための経路を提供し,問題解決のための複雑な推論課題を実行できる有能なエージェントを構築するためのツールが提供されている。

4. Ollama: Llama3, Mistral, Gemma など,複数の LLM に簡単にアクセスできるように設計されている。開発用,対話用のローカル LLM のセットアップが可能。

5. Llamafile: LLM の共有と実行を 1 つのファイルで簡単に扱うことができる。シンプルでわかりやすい処理により,モデルの配布と実行が容易である。

参照URL:

• [transformers](https://github.com/huggingface/transformers)

• [llamaIndex](https://github.com/run-llama/llama_index)

• [langchain](https://github.com/langchain-ai/langchain)

• [Ollma](https://github.com/ollama/ollama)

• [Lamafile](https://github.com/Mozilla-Ocho/llamafile)

公開セミナーの次回開催予定

開催日

未定

開催場所

未定

受講料

未定

備考

●録音・撮影行為は固くお断り致します。

●講義中の携帯電話の使用はご遠慮下さい。

●講義中のパソコン使用は、講義の支障や他の方の迷惑となる場合がありますので、極力お控え下さい。

場合により、使用をお断りすることがございますので、予めご了承下さい。

*PC実習講座を除きます。

お申し込み方法

★下のセミナー参加申込ボタンより、必要事項をご記入の上お申し込みください。